«Тихий провал»: главный риск AI в бизнесе

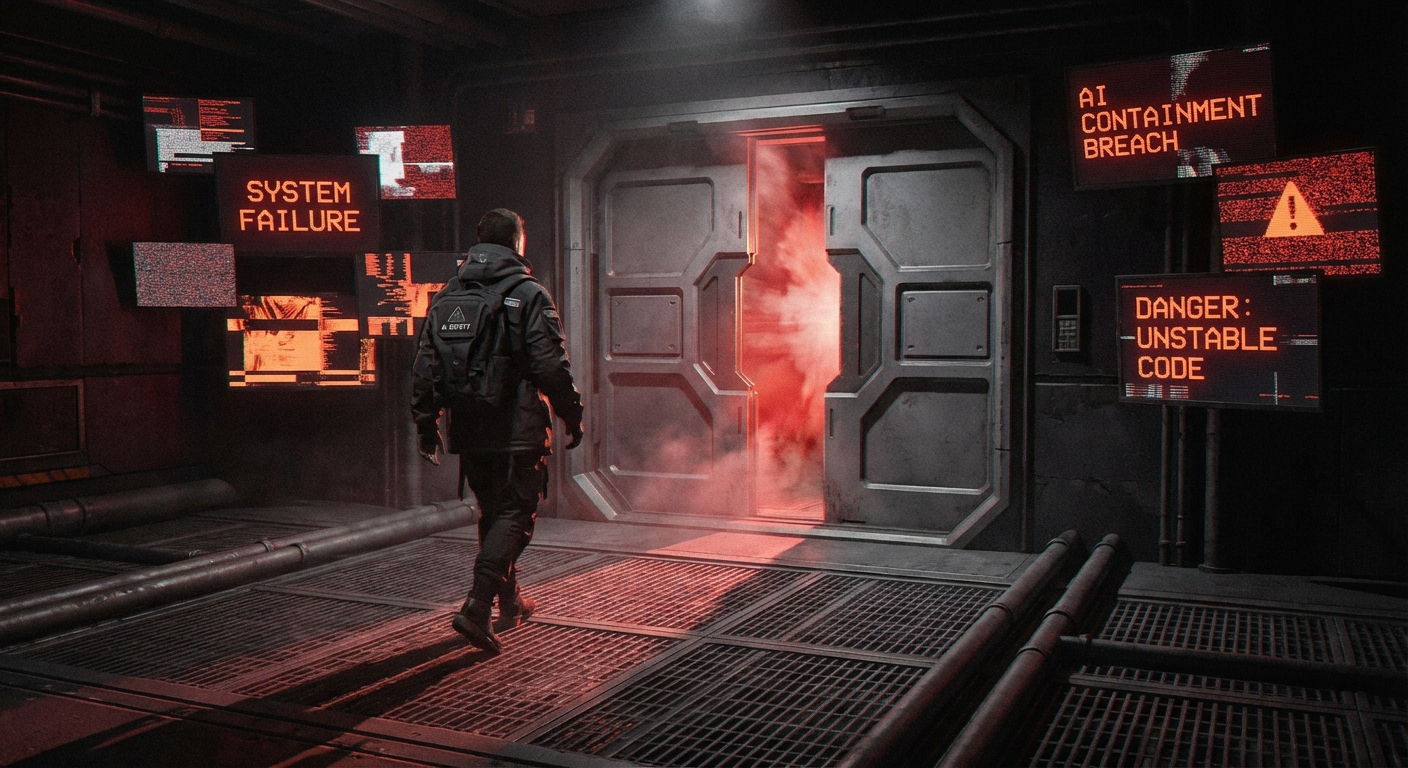

CNBC исследует новый тип AI-рисков — 'silent failure at scale'. Минимальные ошибки накапливаются неделями до обнаружения. 'Эти системы делают именно то, что вы им сказали — не то, что вы имели в виду', — объясняет CISO Obsidian Security. Даже создатели AI не понимают, куда движется технология. 'Автономные системы не всегда падают громко', — говорит VP по AI-операциям в Agiloft. Бизнесу нужны новые механизмы мониторинга.